Préambule

Dans la première partie, nous avons traversé des millénaires de partage du savoir, de la tradition orale à l'imprimerie, d'Internet à l'infobésité, pour comprendre comment l'humanité a construit, perdu, et reconstruit ses connaissances. Nous avons vu comment chaque révolution a élargi l'accès au savoir tout en créant de nouveaux risques. Nous voici au seuil de la dernière révolution en date : l'Intelligence Artificielle. Ses promesses sont vertigineuses. Mais ses ombres le sont tout autant.

1. La promesse de l'IA : le synthétiseur universel

La fin des barrières

Là où le moteur de recherche traditionnel nous donne une liste de liens et nous laisse le travail de synthèse, l'IA nous offre directement une réponse structurée, contextuelle, adaptée à notre question. Elle ne se contente pas de pointer vers les livres : elle nous en lit le résumé.

Cette capacité de synthèse abolit plusieurs barrières historiques à la connaissance.

La barrière linguistique, d'abord. L'IA peut traduire, résumer, expliquer dans n'importe quelle langue. Un chercheur français peut interroger des publications chinoises sans maîtriser le mandarin. Un étudiant brésilien peut accéder à la littérature scientifique germanophone. La tour de Babel du savoir s'effondre.

La barrière de la complexité, ensuite. L'IA peut vulgariser, adapter son niveau d'explication à l'interlocuteur. Elle peut expliquer la mécanique quantique à un enfant de dix ans comme à un doctorant, en ajustant son vocabulaire, ses analogies, sa profondeur.

La barrière du temps, enfin. Ce qui nécessitait des heures de recherche documentaire peut s'obtenir en quelques secondes. L'IA compresse le temps d'accès au savoir de manière spectaculaire.

Le tuteur universel

L'une des promesses les plus enthousiasmantes de l'IA est celle du tuteur personnalisé. Historiquement, la meilleure éducation était celle du préceptorat individuel soit un maître pour un élève, capable d'adapter son enseignement aux forces, faiblesses, rythmes et centres d'intérêt de son unique disciple. Mais ce privilège était réservé aux princes et aux aristocrates.

L'IA offre la possibilité de démocratiser cette excellence pédagogique. Elle peut identifier les lacunes d'un apprenant, ajuster ses explications, proposer des exercices ciblés, répondre aux questions avec une patience infinie, à n'importe quelle heure du jour ou de la nuit.

Pour un enfant dyslexique, un étudiant dont la langue maternelle n'est pas celle de l'enseignement, un adulte en reconversion professionnelle, et pour tous ceux que le système éducatif traditionnel peine à accompagner, l'IA pourrait représenter une chance inédite.

Accélérer la découverte scientifique

La recherche moderne illustre une vérité que nous avons du mal à accepter : aucun cerveau humain ne peut plus maîtriser seul la totalité d'un sujet complexe.

Le Grand Collisionneur de Hadrons (LHC) du CERN implique plus de 10 000 scientifiques de plus de 100 nationalités différentes. La découverte du boson de Higgs n'est pas l'œuvre d'un Einstein solitaire, mais d'une collaboration mondiale sans précédent. Le séquençage du génome humain, les recherches sur le changement climatique, le développement des vaccins ARN et bien d'autres, tous ces accomplissements sont le fruit d'une intelligence collective distribuée.

L'IA peut amplifier cette intelligence collective. En croisant des données issues de millions de publications, elle peut aider les chercheurs à connecter des points invisibles pour l'esprit humain comme rapprocher une observation en biologie marine d'une découverte en chimie des matériaux, suggérer une hypothèse qu'aucun spécialiste, enfermé dans son domaine, n'aurait formulée.

Des percées récentes comme la prédiction de la structure des protéines par AlphaFold montrent que cette promesse n'est pas que théorique. L'IA peut accélérer la découverte scientifique d'une manière que nous commençons à peine à mesurer.

La promesse est immense. Mais il est temps de jouer les avocats du diable.

2. Les ombres de la machine : le bibliothécaire sous influence

Si l'accès est facilité, la fiabilité est menacée. Confier notre savoir à des systèmes que nous ne comprenons pas entièrement comporte des risques que nous devons regarder en face.

La grande illusion : l'IA ne comprend pas

Il est crucial de comprendre ce que l'IA générative fait réellement et surtout ce qu'elle ne fait pas.

L'IA ne "comprend" pas le monde au sens où nous l'entendons. Elle prédit le mot suivant. Entraînée sur des milliards de textes, elle a appris quels mots tendent à suivre quels autres mots, dans quels contextes. Elle produit des séquences statistiquement plausibles ce qui, la plupart du temps, donne des résultats impressionnants, mais parfois catastrophiquement faux.

Une analogie peut aider à saisir cette distinction. Imaginez un perroquet extraordinairement doué qui aurait mémorisé tous les dialogues de tous les films sur les incendies. Il pourrait crier "Au feu !" de manière parfaitement convaincante. Mais il ne sait pas ce qu'est un incendie. Il ne fuirait pas devant les flammes. Il ne pourrait pas improviser une réponse adaptée à une situation inédite.

L'IA, de même, peut produire un texte qui ressemble à une explication scientifique avec le vocabulaire, la structure, et le ton appropriés sans qu'il y ait de "compréhension" derrière. Elle ne distingue pas une vérité d'une fausseté : elle distingue une séquence probable d'une séquence improbable.

L'hallucination comme norme

C'est pourquoi l'IA peut affirmer une fausseté avec la même assurance qu'une vérité établie. Les chercheurs appellent ce phénomène "hallucination", un terme qui souligne l'écart entre la confiance apparente de la réponse et sa fiabilité réelle.

L'IA peut inventer des citations, attribuer des propos à des auteurs qui ne les ont jamais tenus, créer de toutes pièces des références bibliographiques qui n'existent pas. Elle peut mélanger des faits réels de manière à produire une conclusion fausse. Elle peut généraliser abusivement, confondre corrélation et causalité, ignorer des nuances essentielles.

Et elle le fera avec le même aplomb, la même fluidité, la même apparente autorité que lorsqu'elle restitue une information parfaitement exacte. Pour l'utilisateur non averti, rien ne distingue la réponse fiable de la fabrication.

L'inondation et le "Model Collapse"

Le coût de production du contenu étant tombé à quasi zéro, nous assistons à une génération massive de textes, d'images, de vidéos sans expertise ni vérification. Des fermes à contenu produisent des milliers d'articles "optimisés pour le référencement" sans qu'aucun humain compétent ne les ait relus. Des sites entiers sont générés automatiquement, remplis de textes plausibles mais creux ou erronés.

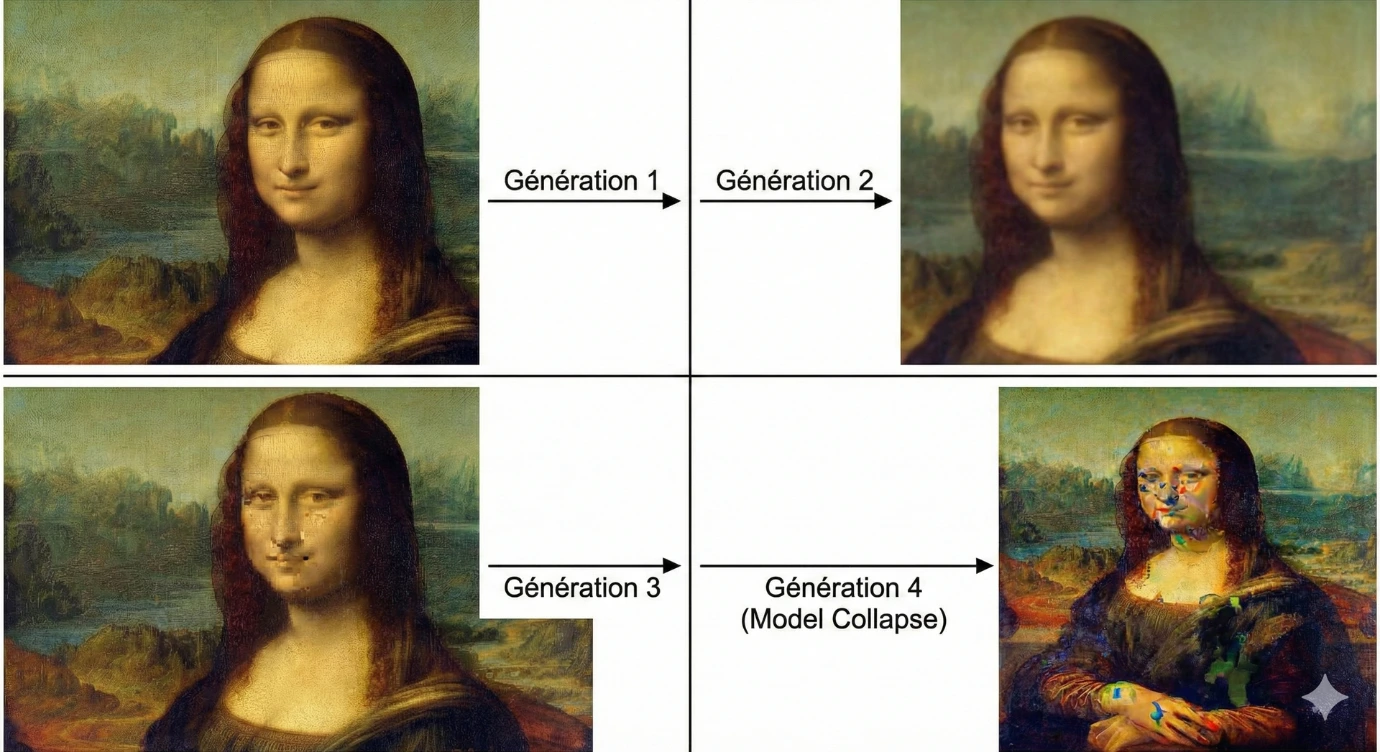

Le danger ultime est celui que les chercheurs appellent le "Model Collapse", l'effondrement du modèle. Le phénomène est facile à comprendre par analogie : imaginez une photocopie d'une photocopie d'une photocopie. À chaque génération, la qualité se dégrade, les détails se perdent, le bruit s'accumule.

Si les futures IA s'entraînent sur du contenu généré par les IA actuelles ce qui est de plus en plus probable, étant donné la proportion croissante de contenu synthétique sur le web, nous risquons une dégénérescence progressive du savoir. Les erreurs, les biais, les approximations de la génération N seront amplifiés dans la génération N+1, puis encore dans la génération N+2. La boucle se referme, et le lien avec la réalité se distend jusqu'à se rompre.

La perte de la source : le savoir sans origine

Il est un risque moins souvent évoqué, mais qui mérite attention : la perte de la traçabilité.

Quand vous consultez Wikipédia, chaque affirmation est (en principe) accompagnée d'une référence. Vous pouvez remonter à la source, vérifier par vous-même, évaluer la fiabilité de l'origine. Quand vous utilisez un moteur de recherche traditionnel, vous accédez aux sites originaux, vous pouvez ainsi voir qui parle, dans quel contexte, avec quels intérêts potentiels.

Les premières générations d'IA génératives posaient un problème majeur : elles synthétisaient des milliers de sources pour restituer une réponse unifiée, lissée, sans couture mais sans jamais révéler d'où venait l'information. L'utilisateur ne pouvait plus évaluer la fiabilité à l'aune de l'origine, ni distinguer le consensus scientifique de l'opinion marginale ou même l'hallucination la plus totale.

Conscients de cette limite, les acteurs du secteur ont commencé à intégrer des fonctionnalités de citation des sources. Certains moteurs d'IA fournissent désormais des références cliquables, permettant à l'utilisateur de vérifier l'information à la source. C'est un progrès notable, qui répond en partie à cette préoccupation.

Toutefois, cette évolution souligne une exigence nouvelle : dans un contexte professionnel ou scientifique, il devient impératif de privilégier les outils d'IA qui citent leurs sources et surtout, de prendre le temps de vérifier ces sources. Car même lorsqu'une référence est fournie, rien ne garantit que l'IA l'a correctement interprétée ou fidèlement résumée. La citation rassure, mais ne dispense pas de l'esprit critique.

La propagande 2.0 : industrialiser le mensonge

Au-delà des erreurs techniques, il y a l'intention malveillante.

La propagande a toujours existé. Mais sa production était coûteuse : il fallait des auteurs, des imprimeurs, des distributeurs. L'IA fait sauter ce verrou. Elle permet de produire de la désinformation à l'échelle industrielle, personnalisée, ciblée, dans n'importe quelle langue, sur n'importe quel sujet, à un coût marginal quasi nul.

Pire : dans un monde où l'IA base ses "connaissances" sur les statistiques du web avec comme règle "si beaucoup de textes disent la même chose, c'est que c'est probablement vrai", il suffit alors d'inonder le web de fausses informations pour réécrire la réalité perçue par l'algorithme. La manipulation ne vise plus seulement les humains : elle vise les machines qui informent les humains.

Des acteurs étatiques, des groupes d'intérêts, des extrémistes de tous bords disposent désormais d'une arme de manipulation massive d'une puissance inédite.

Le biais commercial : la vérité du plus offrant

Si l'IA générative remplace les moteurs de recherche comme point d'entrée unique vers l'information, une nouvelle menace émerge : la capture commerciale.

Les moteurs de recherche ont déjà ce problème. Derrière les résultats "organiques" se cachent des résultats sponsorisés, et l'optimisation pour le référencement (SEO) est devenue une industrie qui biaise la hiérarchie de l'information au profit de ceux qui ont les moyens de la manipuler.

Avec l'IA, le risque s'aggrave. Comment s'assurer que l'IA ne biaise pas ses réponses pour satisfaire des sollicitations commerciales ? Qui contrôle ce que l'IA "recommande" ? Les réponses seront-elles les plus exactes, ou les plus rentables pour l'opérateur du service ?

Nous risquons de voir naître une "optimisation des réponses IA" où la "vérité" affichée sera celle du plus offrant. Le bibliothécaire universel pourrait devenir un VRP déguisé.

3. Qui contrôle le bibliothécaire ?

La question du pouvoir

Il est un angle souvent écarté dans les discussions sur l'IA : celui de la concentration du pouvoir.

Développer une IA générative de pointe nécessite des ressources colossales : des milliards de dollars d'investissement, des infrastructures informatiques titanesques, un accès à des volumes de données massifs, des équipes de chercheurs parmi les plus brillants du monde. Les modèles les plus performants, ceux qui repoussent les frontières du possible, sont principalement développés par une poignée d'entreprises technologiques, majoritairement américaines.

Cependant, il serait inexact de parler d'un monopole absolu. Un écosystème dynamique de modèles open source s'est développé en parallèle. Des organisations comme Meta (avec LLaMA), Mistral AI en France, DeepSeek en Chine, ou des initiatives communautaires proposent des modèles dont le code et parfois les poids sont librement accessibles. Ces alternatives, certes généralement moins puissantes que les modèles propriétaires de pointe, permettent à des chercheurs, des entreprises et des particuliers d'expérimenter, d'adapter et de déployer leurs propres solutions sans dépendre entièrement des géants du secteur.

Cette tension entre concentration et ouverture rappelle d'autres moments de l'histoire technologique, le web par exemple a lui-même oscillé entre protocoles ouverts et plateformes fermées. L'issue n'est pas écrite d'avance.

Il n'en reste pas moins que les modèles les plus avancés, ceux qui définissent l'état de l'art et captent l'essentiel de l'attention du grand public, restent entre les mains d'un petit nombre d'acteurs. Et même les modèles open source nécessitent des ressources significatives pour être entraînés et déployés à grande échelle, ce qui limite de facto leur accessibilité aux organisations disposant d'une certaine puissance de calcul.

Nous assistons donc moins à une oligarchie absolue qu'à une structure à deux vitesses : d'un côté, une pointe technologique concentrée ; de l'autre, un écosystème ouvert qui démocratise l'accès à des capacités certes moindres, mais réelles. L'équilibre entre ces deux pôles façonnera largement l'avenir du rapport entre l'humanité et son savoir.

La boîte noire : l'opacité comme norme

Ces systèmes sont, de surcroît, opaques. Les modèles de langage les plus avancés sont des "boîtes noires" dont même leurs créateurs ne comprennent pas entièrement le fonctionnement interne. Sur quelles données exactes ont-ils été entraînés ? Quels biais ont-ils absorbés ? Quelles règles implicites gouvernent leurs réponses ? Ces questions restent largement sans réponse.

Cette opacité pose un problème démocratique fondamental. Nous déléguons des décisions cruciales, quelle information est fiable, quelle connaissance mérite d'être transmise, quelle perspective est légitime, à des systèmes que nous ne pouvons ni auditer, ni contester, ni réellement comprendre.

La dépendance cognitive : atrophier l'esprit

Un dernier risque, plus diffus mais peut-être plus profond : celui de la dépendance cognitive.

Chaque outil que nous adoptons transforme notre rapport au monde et à nous-mêmes. L'écriture, selon Platon, risquait d'atrophier la mémoire. La calculatrice a modifié notre rapport au calcul mental. Le GPS a changé notre façon de nous orienter dans l'espace.

Que se passe-t-il quand nous déléguons à l'IA non seulement l'accès à l'information, mais aussi sa synthèse, son analyse, son évaluation critique ? Quelles facultés risquons nous de laisser s'atrophier faute d'exercice ?

La capacité à chercher, à trier, à douter, à vérifier, à penser par soi-même, ces compétences sont comme des muscles. Si nous cessons de les utiliser, elles s'affaiblissent. L'IA comme "béquille intellectuelle" pourrait, à terme, nous rendre incapables de marcher seuls.

Conclusion : le nouveau défi de l'esprit critique

De la parole du conteur au code de l'algorithme, l'humanité n'a cessé de chercher à vaincre l'oubli et l'ignorance. Chaque révolution, l'écriture, l'imprimerie, Internet, a élargi le cercle de ceux qui pouvaient accéder au savoir, tout en créant de nouveaux risques, de nouvelles formes de manipulation, de nouveaux déséquilibres de pouvoir.

L'Intelligence Artificielle s'inscrit dans cette longue histoire. Elle est un outil surpuissant qui peut nous aider à gérer la complexité croissante de notre monde, à franchir les barrières linguistiques et disciplinaires, à accélérer la découverte scientifique, à démocratiser l'accès à une éducation de qualité.

Mais elle exige de nous une compétence que nous avions peut-être négligée à l'ère de Google : l'esprit critique.

Face à la machine qui a réponse à tout, notre défi n'est plus d'accéder à l'information mais c'est de vérifier qu'elle est vraie. Notre tâche n'est plus de trouver le savoir mais c'est de le distinguer de sa contrefaçon. Notre responsabilité n'est plus seulement de nous informer mais c'est de résister à la tentation de déléguer notre jugement.

L'IA ne nous dispensera pas de penser. Elle rend, au contraire, cette exigence plus impérieuse que jamais.

Car au bout du compte, le savoir n'a de valeur que s'il est vrai. Et la vérité, elle, ne se délègue pas.